音声認識や画像認識など人間の感覚器の認識能力がAIで実現可能となりつつあり、そう遠くない将来にAIが全人類の知能を超える、いわゆる“シンギュラリティ(技術的特異点)”が来るのではないかと言われている。

当初は、創造的な能力の面についてはAIが人間を超えることはないのではないかと言われていた。しかし、近年、絵画の作成、俳句の作成、新聞記事の作成、小説の執筆など、創造性を要求される分野においてもAIの研究成果が発表されており、限界はなくなりつつあると言える。音楽の作曲についても同様でありAIによる作曲の可能性が高まりつつある。以下では、AIによる作曲について仕組みから事例まで説明する。

AIが作曲する仕組みとは

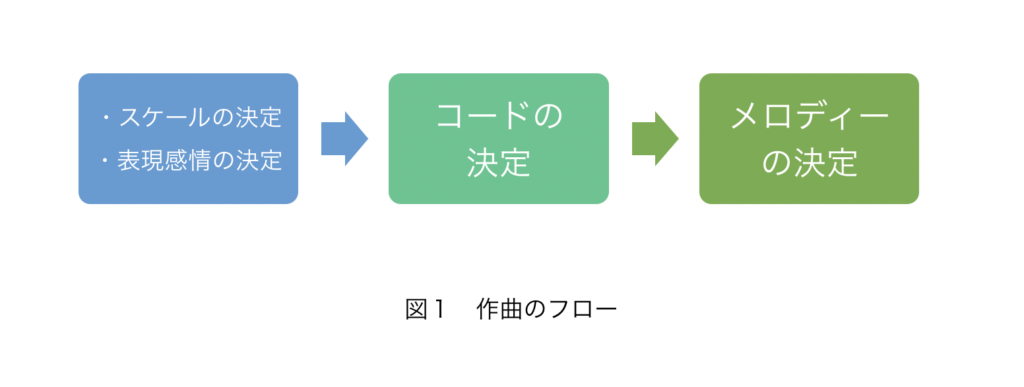

作曲の流れはその構成によって階層化されており、比較的自動化が容易とされている。音楽を構成する3要素はスケール(調)とコード(和音)とメロディ(旋律)とされている。スケールが決まればその構成音に合わせてコードも決まる。コード進行はセオリーがあり、これまでの曲の中で良い進行とされるパターンも数多くあり蓄積されている。コードは曲のムードを大きく左右し、人間のその時の感情、感じ方に非常に影響を与えると言われている。メロディも同様にコードの構成音を元にすれば大きく外れることはないが、単調になってしまう傾向があるので、多少のランダムさが必要とされている要素である。コードに対して大きく外さない範囲で変動させれば単調になるのを防ぐこともできる。メロディの変動を数値化しておきAIによって反映させることにより、盛り上がりなどを制御することも可能である。したがって、人間に曲を聞かせてどのように感じさせたいのか、もしくは、どのような感情の時に聞かせたい曲かというコンセプトを明確にできれば基本となるスケール、コード、メロディはAIによって作成可能となる。

近年では、さらに進化し東京大学大学院情報理工学系研究科システム情報学専攻第一研究室で開発されたOrpheusのように、歌詞のイントネーションから歌いやすさを考慮してメロディーを考えることも可能になっている。また、Song2Guitarという音響信号を入力すると、ギター編曲を自動生成するシステムでは、同様に、人間が弾けるかどうかという制約の基に編曲をしている。このように、AIはあらかじめ与えられたコンセプトをベースにフローに沿って、種々の制約条件を満足した作曲を行う。

<関連記事>

機械学習とディープラーニングの基本

AIと作曲の相性は

BGM的な音楽は、人間の感情を表現する、または、人間の感情を励起する目的という傾向が強い。したがって、抽象的で感覚的な表現の音楽とAIは相性が良いと考えられている。

したがって、作曲において、その目的、また表現すべき人間の感情をイメージし選択、入力する必要がある。しかし、人間の感情を明確に表現する、指定することは難しい。それに対して、2017年に大阪大学COI(Center of Innovation)が、脳波に基づいて自動作曲をするAIを発表している。これによって、人間が曲のムードやジャンルを指定せずとも、AIが脳波を読み取ることで「今どんな音楽を聞かせれば快になるか」を理解することが可能となる。脳波の状態が緊張状態であればリラックスする音を、すなわちリラックスという属性がついた和音、メロディ、音、リズムなどを提案し、脳波が興奮状態ならさらに興奮度を高めるべくハイテンポでハイダイナミクスな音を提案する。こうした「人間の感情や心理的な何かに基づいた自動作曲」というものは研究され続けていくだろう。

AI登場で音楽業界は今後どう変わっていくのか

AIによる作曲は広がっており、フランスのスタートアップ企業であるAivaのようにフルオーケーストラ楽曲を作曲する企業も出てきている。一方、現在、提供されている、または発表されている作曲向けAIは、主に映画音楽やゲーム音楽のような短編のBGBの類である。しかし、AIの技術は進化しているため今後、AI作曲が採用・普及する範囲は更に広がっていくと予想されている。

AIによる作曲の特徴は以下の通りである。

・専門知識がなくても作曲できる

・短時間で作曲できる

・AIが気分を読み取って作曲する

・AIと人間の即興演奏ができる

・作曲家の特徴をまねた曲ができる

上記以外にも、海外では著作権がフリーである、などの特徴を打ち出しているサービスも出てきている。AIが生成した著作物の権利については法整備を待つ必要があるが、いずれにしても将来的に期待できる方向に進化していると言える。

AIが作曲の補助、リアルタイムでアレンジが可能になりつつあり、「10年後は誰でもAIで音楽を作れるようになると予想する。」とAmper Musicを開発した株式会社AmperのCEOのドリュー・シルヴァスタインは話している。

AIが作曲した事例

作曲が可能なAIは次々とリリースされており、作曲家でなくとも作曲が可能な状況になりつつある。現在の代表的なアプリケーション、またはサービスとその作曲例を以下に示す。

・Break Free

ハリウッドの映画音楽作曲家であるドリュー・シルヴァスタインが設立した株式会社Amperが提供するサービスがAmper Musicである。アメリカのシンガーソングライターでYouTuberのタリン・サザンはAmperが作曲した曲を彼女が編曲した「Break Free」を発表している。

・Google Magenta Music

Google Magenta Music(https://www.youtube.com/watch?v=6ZLB2-_0Hxw) はGoogleが「芸術と音楽を創造する過程における機械学習の役割を探求する研究プロジェクト」と追求しているGoogle Magentaプロジェクトによって作曲された曲である。

・Daddy’s Car

ソニーコンピュータサイエンス研究所(SONY CSL)が開発したAIソフト「Flow Machines」は楽曲データベースから「特定の歌手の共通点」を抽出して作曲するシステムである。「Flow Machines」によって作曲され、ブノワ・カレによって編曲された「Daddy’s Car」(https://www.youtube.com/watch?v=LSHZ_b05W7o)はAIによって作曲された曲で最も有名な1曲である。

・Sweet Abyss

JukeDeck Musicは人工知能が自動的に作曲してくれるアプリサービスである。このサービスを用いて作曲された例が「Sweet Abyss」(https://www.youtube.com/watch?v=SrQfA-S939I)という曲である。

・Op. 24, I am AI

「Op. 24, I am AI」は、上記のフランスのスタートアップ企業がAIによって作曲したフルオーケストラの曲である。

まとめ

音楽は人間の感情を表現する、または感情を励起するという意味において非常に創造的であるが、その作曲という活動はセオリーに基づいて実行されている。また、対象とする感情とコードや、メロディーの対応については過去のデータが多くされている。したがって、人間が目標とする感情の動きを明確にし入力すればセオリーの部分についてはAIによって実行可能になりつつある。感情の動きについても脳波を直接計測し推定することも可能になっている。ごく近い将来、AIを利用することで専門家以外でも短時間に作曲できるようになることで、音楽業界は大きく進歩することが予想される。

<関連記事>

AIが感情を認識する仕組みとは【活用事例もあわせて紹介】

<参考>

- 人工知能が作曲家に。Amper Musicとは?事例や仕組みを解説(TECH::NOTE)

https://tech-camp.in/note/technology/42681/ - 人工知能は作曲家になり得るのか? AI作曲の可能性を実例から検証(Real Sound)

https://realsound.jp/2018/01/post-149572.html - 機械が作った音楽は人の心を動かすか 「AIで自動作曲」研究するワケ(ITmedia NEWS)

http://www.itmedia.co.jp/news/articles/1811/09/news007.html

役にたったらいいね!

してください

NISSENデジタルハブは、法人向けにA.Iの活用事例やデータ分析活用事例などの情報を提供しております。