AI(人工知能)の活用が拡がりを見せている。特にSNSをはじめとするインターネットへの投稿内容の自動監視は、B2Cで展開する企業への福音となる。

続きを読むAIがSNSを監視するメリットとは

パート社員やアルバイトがSNSに不用意な内容を書き込まれたことによって、企業が謝罪に追い込まれるという案件、通称「バイトテロ」が定期的に発生している。「バイトテロ」を起こす人々は「バカッター」などと呼ばれて、法的措置を執られるなど痛い目にあうわけだが、企業の方からするとたまったものではないだろう。

また、社員やアルバイトだけではない。ちょっとした不手際や行き違いがSNSで大きく拡散される、場合によっては完全に言いがかりと言って良いような内容、いわばフェイクニュースの様な内容が簡単に拡散する。それ以外にも、掲示板全盛の時代には「2ちゃんねる」で悪意のある内容が拡散されて、名誉毀損で訴える、訴えられるということが起こっていた。

もちろん、未成年が「学校裏サイト」やSNS上でいじめを行う、ということも繰り返されている。SNSをはじめとするインターネット上で情報を発信することができるサイトというのは、こういった問題が数多く見つかる場所でもある。

こういうSNS上の投稿は、運営側が発見し次第削除するなどの対応を取っているものの、投稿数が飛躍的に伸びた昨今では、人力で行うには限度がある。これを何とか自動化しようと、過去には特定キーワードが入った投稿をピックアップするっステムや、それらを投稿できないようにブロックしたりするシステムも開発されたが、投稿する側も隠語のような物を使って、これらの規制をすり抜けるという、いたちごっこ状態になっていた。

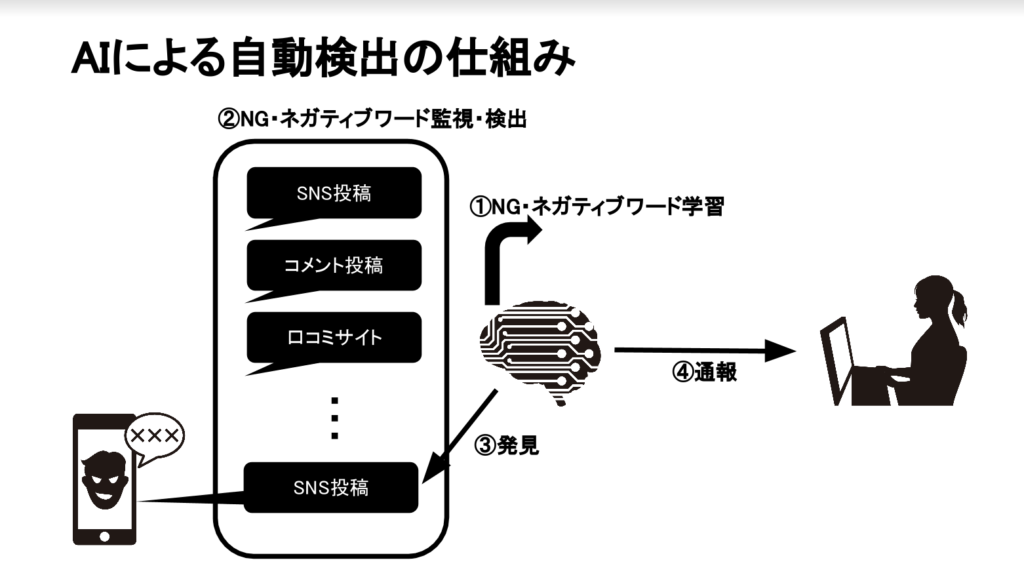

そこでここ数年、AI(人工知能)を使って、ユーザーによる投稿を監視し、いち早く問題となる内容をピックアップし、場合によってはすみやかに削除するような取り組みが始まっているのだ。AIを活用することで、問題のある内容としてピックアップするべき投稿を自動的に発見し、サイトの管理者に通知することで、問題が大きくなる前に対処できるようになる。

AIがSNSを監視する仕組みとは

では、AIはどの様にしてSNSの内容を監視するのだろうか。詳しく説明しよう。

まず大きく分けて、2つの監視方法がある。それらは目的に応じて変わるため、どちらが良いというのではなく、目的に応じた使い分けが必要である。

まず1つ目は不適切投稿の監視である。先にも紹介したが、これまでは人力で不適切投稿を探してきた。ただし、現状のように投稿数がうなぎ登りで増え、また写真や動画の投稿が中心になってきているため、人力による監視を続けるのは現実的ではない。そこで、不適切な投稿だと運営側で判断したものをAIに学習させ、NGワードやネガティブワードが入っている投稿や、これまでNGとしていた内容に似たような投稿を検出させるという技術が発達した。AIに対する教師あり学習の例である。

この応用として、近年では投稿された画像や動画がネガティブではないかと思われる投稿についても、画像認識AIで学習させて、自動検出するという研究が進んでいる。

一方、とりあえずAIにSNSの投稿内容を分類させ、そこからNGだと考えられる傾向の投稿をピックアップして報告させるという手法も開発されている。教師なし学習というか、情報のクラスタリングである。

このタイプのAIが完成すると、これまでは炎上案件だと考えていなかった内容や、炎上につながっていく可能性のある会話の流れなどを検出できるようになる可能性がある。投稿後にモグラ叩き的に何とかするのではなく、そういう投稿が行われそうになる状況を検知できるようになれば、投稿される前に予防することができるようになるかもしれない。

次からは実際に開発され、導入された事例を紹介する。

エルテス(事例紹介)

エステル社は東京都千代田区に本社を置く企業である。主力はSNSを含む120以上のインターネットメディアを対象にした監視サービスである。特に炎上に繋がりやすい投稿をいち早く発見し、契約している企業へと通知を行い、素早い対応を促している。

そのためにはできる限り早く問題となりそうな投稿を発見しなければならないが、ここにAIを監視役として導入している。契約している企業の業種に合わせ、炎上につながるNGワードやネガティブなワードを登録しておくことで、投稿がポジティブ(好意的)なのかネガティブ(批判的)なのか、それともニュートラル(中立的)なのかを判断するという。ネガティブな投稿も人間によるダブルチェックを行い、契約している企業に通知することで、同社のサービスを利用している企業も、あまり振り回されることなく、対応に集中できるようにしている。

もともとは2000年代に流行した口コミサイトで、ネガティブなコメントが時に成業できない炎上状態になるのを見て、これを自動検出することをビジネスにしたという。実際には神戸大学や東京大学と共同研究を行い、投稿されたテキストがネガティブであるか同化を判断するAIを開発した。また現在も、画像認識技術で、投稿された画像がネガティブかどうかを判断するAIを研究中であるという。

さらに、従業員による重要情報の流出防止サービスも2016年からは提供している。ここでは重要文書へのアクセス履歴、インターネットでの検索履歴、勤怠記録や印刷記録などから、不正を行うリスクの高い活動を特定し、管理者へ報告することで内部不正や情報流出を防ごうとしている。

そのうえ、2020年のオリンピック・パラリンピックを前に、テロ活動を未然に検知するようなAIの開発も進めている。テロの予兆をインターネット上の投稿を監視することで発見し、未然に防ぐというものだが、ここでも同社のSNS監視技術が役に立っている。

Bark(事例紹介)

もう一つの事例として、アメリカのスタートアップであるBark社のサービスを紹介する。同社は子どもたちのテキストメッセージやメール、YouTube、SNSへの投稿を監視し、そこから危険を察知して警告を行うサービスの開発と提供を行っている。

実際に、2017年からアプリのテストパイロットを25校で行っていたところ、爆破事件や銃撃事件が発生しそうな予兆を発見したとのこと。そして2018年2月にはフロリダ州の高校で17人が死亡する銃撃事件が発生した。

現在提供されているアプリは児童心理学者や法執行機関の専門家たちと協力して開発されている。AIは注意が必要なワードなどを機械学習で学習し、SNSの投稿やメールなどからいじめやうつ病、自殺など「潜在的な脅威」を識別して、両親や学校に警告を送る。銃撃事件が発生しそうな場合にはFBIへも通報が行われる。

有料版のアプリは1家族につき月額9ドルで、年額だと99ドルである。また無料版のアプリは2019年2月時点では1100学区で使用され、約260万人の子どもがサービスの恩恵を受けている計算となる。おそらく今後も同様のサービスを含め、世界的に拡がっていくものと思われる。

まとめ

AI(人工知能)による自然言語処理はこの数年で大きく発展した。英語などの欧米系言語と比較すると日本語はまだまだ精度の点で難が残っているが、それでも十分に実用的なレベルに達している。

この自然言語処理系AIにこれまでのSNSや掲示板、口コミサイトの炎上防止運用の知見で得られた、NGワードや炎上につながるネガティブワードを学習させることで、炎上する前に予兆を発見して対策をしようという流れが加速している。実際に人力で膨大な数の投稿を監視するのは不可能になっており、ここはAIの出番というわけだ。

そしてこの技術は不適切画像や動画の監視・発見という方向と、社内の内部不正発見や情報流出防止技術へと進化しつつある。将来的には、NGやネガティブといったワードそのものが投稿内になくても、全体的な議論の流れや会話の流れから、炎上につながる一連の流れを検出し、これらのワードそのものが発せられなくするような方向へと技術が進化していくのかもしれない。

<参考>

- AIがリアルタイムでスパム投稿を監視・削除!データセクションが新ソリューションをリリース(MarkeZine)

https://markezine.jp/article/detail/27413 - SNSを常時監視。リスクを管理するエルテス(日経ビジネス)

https://business.nikkei.com/atcl/report/15/278209/041100117/ - AIに学生のメールやSNSを監視させて「危険」を検知するという試みが行われている(Gigazine)

https://gigazine.net/news/20190218-ai-boost-school-safety/ - SNSでの“違法取引”を監視する「CtoCパトロールサービス」–イー・ガーディアンが提供(CNET Japan)

https://japan.cnet.com/article/35128888/ - SNS監視とは | 企業内外のリスクを最少化する対策・おすすめサービス紹介(BOXIL)

https://boxil.jp/mag/a3789/ - 事件を起こしそうな人物・組織をSNSの投稿・言動・日時・場所などのビッグデータから予測可能なソフトウェアを警察がテスト中(Gigazine)

https://gigazine.net/news/20141031-software-prediction-crime/

役にたったらいいね!

してください

No related posts.